Över helgen, Youtube aktivisten Matt Watson slog in på Reddits förstasida med en video om en störande fenomen som han upptäckte på Googles videovärdplattform, världens näst största sökmotor. Watson visade hur han kunde klicka sig igenom normalt, lämpligt YouTube-innehåll mot suggestiva videor av unga flickor. Även om många av dessa videor, som visar preteens som bär bikini och vampar i sina sovrum, inte var explicit sexuella, hade de flesta kommenterats av användare med till synes pedofil avsikt. Vissa kommentarer innehöll tidsstämplar för specifika ögonblick när de unga flickorna var i kompromissande positioner. Vissa kommentarer innehåller länkar till privata, olistade videor. Dessa YouTube-klipp genererades intäkter via annonser för företag som Grammarly och Google själv.

Kort efter Watsons video, som visade honom uttrycka skräck över fenomenet, klättrade på Reddit-rankingen, medieorganisationer och annonsörer svarade. Gränsen rapporterade det Episka spel, företaget bakom Fortnite, drog sina pre-roll-annonser från YouTube efter att Watsons inlägg blev viralt och Peloton, inomhusträningen cykelföretaget sa att de arbetade för att ta reda på varför deras annonser pressades mot olämpliga innehåll. YouTube svarade också och uppdaterade sitt "kanalanslagssystem". Det systemet, som inte har uppdaterats på ett decennium, varnar användare som beter sig olämpligt

Detta var något, men som Forbes, Mashable, Business Insider, och The New York Times Alla påpekade att det inte var en lösning på ett uppenbart algoritmiskt, mänskligt eller maskininlärningsproblem.

Intressant nog hade många videor Watson såg inaktiverade kommentarer, vilket tyder på att YouTubes innehållshanterare har lagt märke till raden av kommentarer och har försökt göra det svårare för pedofiler att operera sina webbplats. Men alla dessa ansträngningar som bekräftades var en medvetenhet om det olösta problemet.

Faktum är att det är klart att problemet går tillbaka till åtminstone 2017. Samma månad som "Elsagate” kontroversen exploderade, folk hade börjat ringa larm om konstiga, implicit sexuella kommentarer på videor av små barn, gjorda för barn. Stora annonsörer gillar AT&T slutade spendera för annonser på webbplatsen när BBC rapporterade att olämpliga kommentarer på intäktsgenererade videor av barn ofta inkluderade tidsstämplar för andra långa stunder av suggestiva positioner och länkar till olistade videor – och annonsörer återupptog inte utgifterna förrän problemet var "löst". På 21 februari, AT&T, som precis hade börjat annonsera på plattformen igen i januari, sa att de skulle sluta spendera på annonser på plattformen. Hasbro, Nestle och Disney har alla följt efter.

Elsagate är inte detsamma som en pedofiliring, men problemen hänger ihop. Innehållsgårdar utnyttjade sökord och placerade automatiskt annonser baserat på kanalengagemang och dålig AI-filtrering och skapade tecknade serier som använde olicensierade karaktärer från populära barn franchiseavtal. Många av dessa "innehållsgårdar" — det vill säga, företag som skapade dessa videor — har sitt huvudkontor på platser som Ho Chi Minh City, Vietnam. De var inte pedagogiska eller barnvänliga, utan spred sig på YouTube-barn som intäktsgenererande videor.

Youtube ändrat sina riktlinjer för intäktsgenerering efter de dubbla 2017-skandalerna. Idag måste videoskapare ha minst 1 000 prenumeranter och ha sett sina videor i 4 000 timmar. Dessa regler infördes först efter Elsagate och nu hävdar företaget att alla videor som tjänar pengar på kommer att granskas av verkliga människor, inte AI, för att stävja olämplig reklam som visas (tänk: en Google-annons som prerollar en video av en mellantjej som äter en klubba som har haft över 1 miljon visningar).

Det är därför så många videor av barn har kommentarer inaktiverade under videorna. YouTubes 10 000 mänskliga granskare, som har till uppgift att granska de 400 timmars film som laddas upp till YouTube varje minut, är också ansvariga för att titta över engagemanget med nämnda videor och inaktivera olämpliga kommentarer, länkar till olistade videor eller tidsstämplar för barnen i suggestiva positioner.

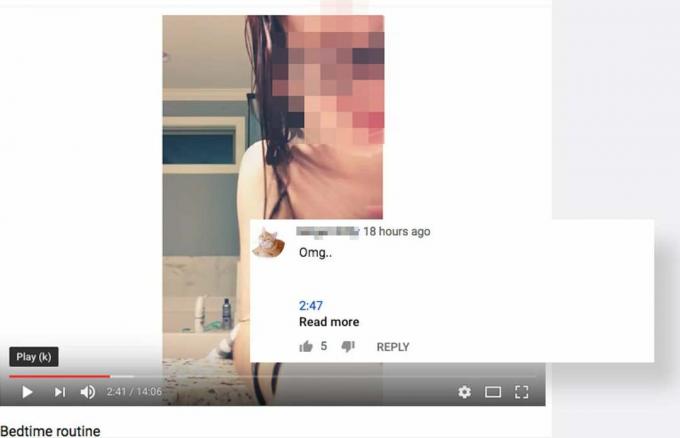

Jag skapade ett nytt YouTube-konto efter att ha upptäckt att mina algoritmer var så förankrade att det var svårt att hitta olämpligt innehåll och sökte samma sak som Watson sökte — "bikini haul." Inom 12 klick befann jag mig i en konstig kaninhåla av barnbrottningsvideor och tjejkvällar rutiner. Jag snubblade över en 30+ minuters video och hittade detta:

Klockan 21:25 rörde sig flickan i videon bort från kameran och för bara en sekunds blixt var hennes gren i sikte.

Jag stötte också på en mängd modellvideor av unga flickor klart under 18 år. Kommentarer noterade hur vackra modellerna var och hur snygga de såg ut i sina underkläder, trots att dessa är barn. Jag delar inte videorna eftersom de är olämpliga. men faktum är att inte bara dessa kommentarer bör övervakas länge, de kanske inte borde finnas på webbplatsen alls. Inga åtgärder har vidtagits mot dessa kommentarer eller själva videon av minderåriga som modellerar underkläder.

Och en annan tjej postade en video av sin nattrutin, efter duschen. Flickan, vars YouTube-sida heter "Makenzies Fortnite-upplevelse” och som inte verkar vara mer än 13 år gammal, flyttar av misstag hennes handduk på ett sätt i videon som sidan av hennes nakna överkropp visar vid 2:47 minuter.

Självklart borde den här videon aldrig ha laddats upp. Flickan i den är tydligt pre-puberscent och har en handduk på sig, vilket förklarar sin nattrutin. Den här videon har cirka 51 000 visningar. Resten av hennes videor har mellan åtta och 150 visningar. Så varför händer detta? Vet hon varför 51 000 personer har sett den här videon och ingen av hennes Fortnite-videor eller roliga hantverksvideor? Förstår hon att det finns människor där ute som inte tittar på det här för att de egentligen inte bryr sig om hennes nattrutiner utan vill se en liten flicka i en handduk? Kanske. Kanske inte. Hon är ett barn. Någon borde övervaka hennes internetanvändning mer noggrant, men det är också svårt. Och det är där YouTube borde komma in, men har inte. Detta är olämpligt innehåll även om det inte är uppenbart sexuellt på grund av hur det sannolikt kommer att konsumeras. Det här är inga kittlande saker om du inte är den typen av person som specifikt tycker att det är kittlande.

Även om dessa videor inte tjänade pengar på annonser, övervakades de inte heller av människor eller AI - åtminstone inte effektivt. En del av videorna borde inte finnas på YouTube alls utan har miljontals visningar. Om kommentarer och moderering av innehåll är så ineffektiva som det verkar, kommer barn att fortsätta att vara föremål för sexuellt intresse på plattformen, som kommer att fortsätta att vara ett verktyg för rovdjur.

Allt eftersom YouTube blir en plats där fler och fler barn konsumerar video samt en plats där de visar upp sina skapelser, kommer de som ansvarar för plattformen måste fatta ett beslut om huruvida måttfullhet bör eftersträvas i intresse av rimlig förnekelse eller för att skydda barn. Om företaget kommer till den senare slutsatsen – och låt oss hoppas att det gör det – måste de ompröva både sin personalstyrka och sin mjukvara. Om de inte gör det bör de ompröva vilken roll de vill spela på internet.