Facebook llegó para quedarse y, desafortunadamente, también lo están los desafíos que conlleva la moderación de las horribles imágenes de abuso que ocasionalmente surgen en línea. Durante el fin de semana el guardián publicó una selección de los manuales de moderación internos de Facebook, que arrojan luz sobre cómo la empresa modera las imágenes que representan el abuso infantil no sexual.

"Permitimos que se comparta 'evidencia' de abuso infantil en el sitio para permitir que el niño sea identificado y rescatado", explica una de las diapositivas. "Pero agregamos protecciones para proteger a la audiencia".

los los manuales explican que los moderadores de Facebook eliminan imágenes solo después de que se informan, y dejan intencionalmente algún gráfico contenido en vivo para que los miembros de la comunidad puedan extraer imágenes en busca de pistas cruciales que puedan ayudar a rescatar a un abusado niño. Es un pensamiento noble, pero los defensores dicen que sería mejor que la empresa simplemente eliminara estas imágenes y se las pasara a los profesionales. “En la mayoría de los casos, la realidad de compartir imágenes viles y violentas de violencia y abuso infantil simplemente perpetúa la humillación y abuso de un niño ”, Yvette Cooper, política británica y presidenta del comité selecto de asuntos de interior, dijo al

El guardián | Diapositiva del manual de moderación de Facebook

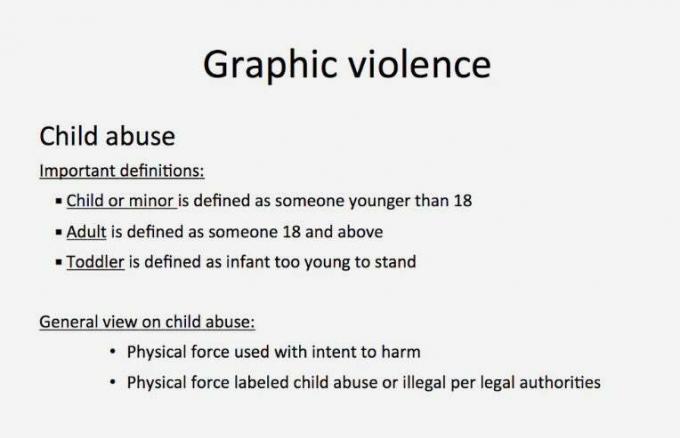

Facebook define el abuso infantil como cualquier acción física con la intención de dañar, o cualquier acción definida como abuso por las autoridades. Según el manual, los moderadores solo necesitan eliminar imágenes de abuso infantil no sexual cuando se comparten con sadismo y celebración. De lo contrario, estas imágenes simplemente se etiquetan como "perturbadoras". Incluso las transmisiones en vivo que muestran autolesiones no necesitan ser eliminadas o marcadas, de acuerdo con el manual, porque eso constituiría censura.

Claire Lilley, directora de seguridad infantil en línea de la Sociedad Nacional para la Prevención de la Crueldad contra los Niños (NSPCC), sugiere que Facebook reescriba sus pautas desde cero y rápidamente. El NSPCC tiene criticado el gigante de las redes sociales en el pasado, por permitir que un video de un bebé sumergido en agua permanezca en línea. "Queremos que se tomen las imágenes de abuso infantil no sexual tan en serio como lo hacen con las imágenes de abuso sexual", Lilley. dice.

“Me gustaría verlos dar un paso atrás y mirar las pautas que entregan a sus moderadores y ver las contradicciones que son inherentes a ellos. Necesitan tirarlos y empezar de nuevo con una hoja de papel en blanco ".