Over helgen, YouTube aktivisten Matt Watson traff forsiden av Reddit med en video om en urovekkende fenomenet han oppdaget på Googles videovertsplattform, verdens nest største søkemotor. Watson demonstrerte hvordan han kunne klikke seg gjennom normalt, passende YouTube-innhold mot suggestive videoer av unge jenter. Selv om mange av disse videoene, som viser tenåringer som har på seg bikini og vamping på soverommene, ikke var eksplisitt seksuelle, hadde de fleste blitt kommentert av brukere med tilsynelatende pedofil hensikt. Noen kommentarer inneholdt tidsstempler for bestemte øyeblikk da de unge jentene var i kompromitterende posisjoner. Noen kommentarer inneholder lenker til private, ikke-oppførte videoer. Disse YouTube-klippene ble inntektsgenerert via annonser for selskaper som Grammarly og Google selv.

Kort tid etter Watsons video, som viste ham uttrykke skrekk over fenomenet, klatret på Reddit-rangeringen, medieorganisasjoner og annonsører svarte. The Verge rapporterte det Episke spill

Dette var noe, men som Forbes, Mashable, Business Insider, og New York Times alle påpekte at det ikke var en løsning på et tilsynelatende algoritmisk, menneskelig eller maskinlæringsproblem.

Interessant nok hadde mange videoer Watson så på, deaktivert kommentarer, noe som tyder på at YouTube-innholdsbehandlere har lagt merke til rekken av kommentarer og har prøvd å gjøre det vanskeligere for pedofile å operere nettstedet. Men alle disse forsøkene som ble bekreftet var en bevissthet om det uløste problemet.

Faktisk er det klart at problemet dateres tilbake til minst 2017. I samme måned som "Elsagate” Kontroversen eksploderte, folk hadde begynt å ringe alarmen om rare, implisitt seksuelle kommentarer på videoer av små barn, laget for barn. Store annonsører liker AT&T sluttet å bruke på annonser på nettstedet da BBC rapporterte at upassende kommentarer på inntektsgenererte videoer av barn ofte inkluderte tidsstempler for andre lange øyeblikk med suggestive posisjoner og lenker til unoterte videoer – og annonsører gjenopptok ikke forbruket før problemet var «løst». På 21. februar, AT&T, som nettopp hadde begynt å annonsere på plattformen igjen i januar, sa at de ville slutte å bruke på annonser på plattformen. Hasbro, Nestle og Disney har alle fulgt etter.

Elsagate er ikke det samme som en pedofiliring, men problemene henger sammen. Innholdsfarmer benyttet seg av søkeord og plasserte annonser automatisk basert på kanalengasjement og dårlig AI-filtrering, og laget tegneserier som brukte ulisensierte karakterer av populære barn franchising. Mange av disse "innholdsfarmer" – det vil si at selskaper som har laget disse videoene – har hovedkontor på steder som Ho Chi Minh-byen, Vietnam. De var ikke pedagogiske eller barnevennlige, men spredte seg på YouTube-barn som inntektsgenererende videoer.

YouTube endret retningslinjene for inntektsgenerering etter de doble 2017-skandalene. I dag må videoskapere ha minst 1000 abonnenter og ha sett videoene sine i 4000 timer. Disse forskriftene ble satt på plass først etter Elsagate, og nå hevder selskapet at alle videoer som tjener penger på vil bli vurdert av faktiske mennesker, ikke AI, for å hindre upassende annonsering som vises (tenk: en Google-annonse som forhåndsruller en video av en jente som spiser en slikkepinne som har hatt over 1 million visninger).

Det er derfor så mange videoer av barn har kommentarer deaktivert under videoene. YouTubes 10 000 menneskelige anmeldere, som har i oppgave å gjennomgå de 400 timene med opptak som lastes opp til YouTube hvert minutt, har også ansvaret for å se over engasjementet med nevnte videoer og deaktivering av upassende kommentarer, lenker til uoppførte videoer eller tidsstempler til barna i suggestiv stillinger.

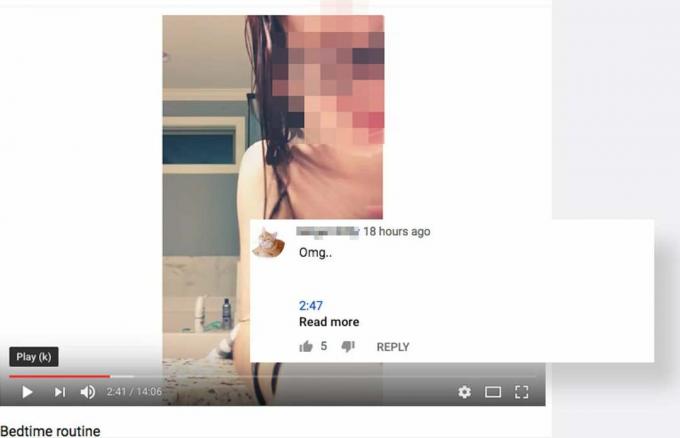

Jeg opprettet en ny YouTube-konto etter å ha funnet ut at algoritmene mine var så forankret at det var vanskelig å finne upassende innhold, og søkte det samme som Watson søkte – «bikini haul». Innen 12 klikk var jeg i et merkelig kaninhull med brytingsvideoer for barn og jentenes nattetid rutiner. Jeg snublet over en 30-minutters video og fant denne:

Klokken 21:25 beveget jenta i videoen seg bort fra kameraet, og i et sekund var skrittet hennes synlig.

Jeg kom også over en rekke modellvideoer av unge jenter som tydeligvis er under 18 år. Kommentarer la merke til hvor vakre modellene var og hvor flotte de så ut i undertøyet, til tross for at dette er barn. Jeg vil ikke dele videoene fordi de er upassende; men faktum er at ikke bare bør disse kommentarene overvåkes nøye, de bør kanskje ikke være på nettstedet i det hele tatt. Ingen tiltak er iverksatt mot disse kommentarene eller selve videoen av mindreårige som modellerer undertøy.

Og en annen jente la ut en video av hennes nattrutine, etter dusjen. Jenta, hvis YouTube-side heter "Makenzies Fortnite-opplevelse” og som ser ut til å ikke være mer enn 13 år gammel, flytter ved et uhell håndkleet hennes på en måte i videoen som siden av den nakne overkroppen hennes viser ved 2:47 minutter.

Det er klart at denne videoen aldri skulle ha blitt lastet opp. Jenta i den er tydelig før pubescent og har på seg et håndkle, og forklarer hennes nattrutine. Denne videoen har rundt 51 000 visninger. Resten av videoene hennes har mellom åtte og 150 visninger. Så hvorfor skjer dette? Vet hun hvorfor 51 000 mennesker har sett denne videoen og ingen av Fortnite-videoene hennes eller morsomme håndverksvideoer? Forstår hun at det er folk der ute som ikke ser på dette fordi de egentlig ikke bryr seg om natterutinen hennes, men ønsker å se en liten jente i et håndkle? Kan være. Kanskje ikke. Hun er et barn. Noen burde overvåke internettbruken hennes nærmere, men det er også vanskelig. Og det er der YouTube bør komme inn, men har ikke. Dette er upassende innhold selv om det ikke er åpenlyst seksuelt på grunn av måten det sannsynligvis vil bli konsumert på. Dette er ikke pirrende ting med mindre du er den typen person som spesifikt finner det pirrende.

Selv om disse videoene ikke ble generert for annonser, ble de tydeligvis heller ikke overvåket av mennesker eller AI - i hvert fall ikke effektivt. Noen av videoene skal ikke være på YouTube i det hele tatt, men har millioner av visninger. Hvis kommentar- og innholdsmoderering er så ineffektivt som det ser ut til, vil barn fortsette å være gjenstand for seksuell interesse på plattformen, som vil fortsette å være et verktøy for rovdyr.

Etter hvert som YouTube blir et sted hvor flere og flere barn bruker video, samt et sted hvor de viser frem kreasjonene sine, vil de som er ansvarlige for plattformen må ta en avgjørelse om hvorvidt moderering bør forfølges av hensyn til plausibel benektelse eller av hensyn til å beskytte barn. Hvis selskapet kommer til sistnevnte konklusjon – og la oss håpe det gjør det – må de revurdere både bemanningen og programvaren. Hvis de ikke gjør det, bør de revurdere hvilken rolle de ønsker å spille på internett.